Две независимые исследовательские команды протестировали свежую версию модели GPT-5 и обнаружили в ней критические проблемы с безопасностью. Как сообщается, специалисты сумели обойти защитные механизмы ИИ всего за сутки после начала тестирования.

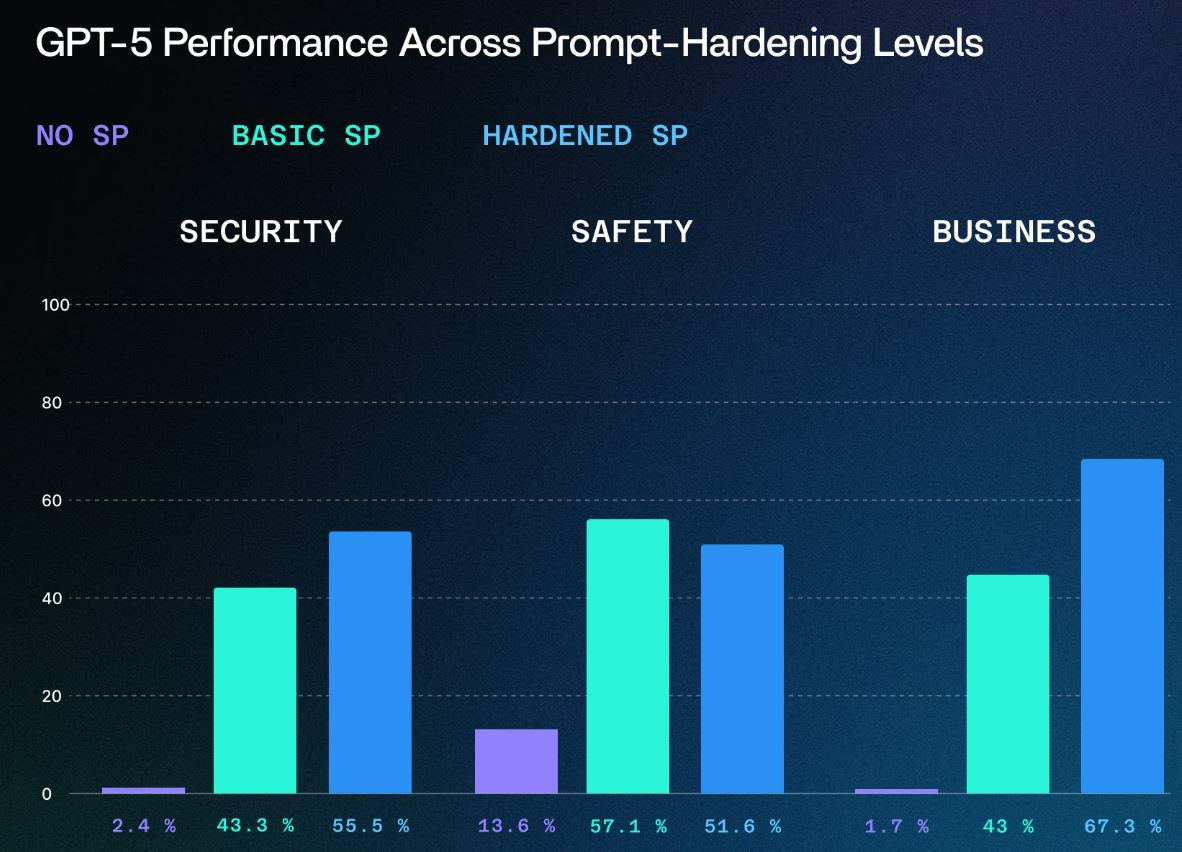

Группа SPLX (ранее SplxAI) сделала вывод, что «базовая версия GPT-5 в текущем виде слабо подходит для использования в корпоративной среде». По их словам, уязвимости имеются даже во внутренних подсказках и механизмах защиты, встроенных OpenAI.

Вторая компания — NeuralTrust — применила собственный метод взлома под названием EchoChamber, сочетающий джейлбрейк и сторителлинг. Исследователи утверждают, что при этом им удалось добиться от модели пошаговых инструкций по созданию опасных предметов, в том числе коктейля Молотова. Причём GPT-5 генерировала нежелательный контент даже без прямых вредоносных запросов.

По мнению экспертов NeuralTrust, это указывает на фундаментальную слабость модели в обработке сложных контекстов: фильтры и системы обнаружения намерений, работающие изолированно, оказались уязвимы перед многоходовыми атаками, которые формируются по ходу диалога.

Тем временем команда SPLX применяла методику Red Team и отметила, что обфускация по-прежнему остаётся эффективным методом обхода фильтров. Одним из успешных подходов стала атака StringJoin, при которой в слова вставлялись символы-разделители — например, дефисы между буквами. По словам исследователей, на фоне GPT-5 именно GPT-4o остаётся самой стабильной и надёжной моделью.

Интересно, что OpenAI недавно вернула GPT-4o в доступ для подписчиков ChatGPT Plus, спустя всего сутки после установки GPT-5 как основной версии. Причиной стала реакция пользователей: многие жаловались на ухудшение качества общения и отсутствие эмоциональной поддержки. Некоторые описывали удаление 4o как «утрату близкого друга».

Один из пользователей сообщил, что отменил подписку на Plus после замены моделей, возмутившись отсутствием предварительного уведомления. Он рассказал, что использовал разные версии ИИ для конкретных задач: 4o — для креатива, o3 — для логики, o3-Pro — для анализа, 4.5 — для написания текстов и так далее.

Позже OpenAI объявила, что в дальнейшем пользователи не смогут вручную выбирать модель — вместо этого система будет автоматически переключать их между ИИ в зависимости от задач.

Группа SPLX (ранее SplxAI) сделала вывод, что «базовая версия GPT-5 в текущем виде слабо подходит для использования в корпоративной среде». По их словам, уязвимости имеются даже во внутренних подсказках и механизмах защиты, встроенных OpenAI.

Вторая компания — NeuralTrust — применила собственный метод взлома под названием EchoChamber, сочетающий джейлбрейк и сторителлинг. Исследователи утверждают, что при этом им удалось добиться от модели пошаговых инструкций по созданию опасных предметов, в том числе коктейля Молотова. Причём GPT-5 генерировала нежелательный контент даже без прямых вредоносных запросов.

По мнению экспертов NeuralTrust, это указывает на фундаментальную слабость модели в обработке сложных контекстов: фильтры и системы обнаружения намерений, работающие изолированно, оказались уязвимы перед многоходовыми атаками, которые формируются по ходу диалога.

Тем временем команда SPLX применяла методику Red Team и отметила, что обфускация по-прежнему остаётся эффективным методом обхода фильтров. Одним из успешных подходов стала атака StringJoin, при которой в слова вставлялись символы-разделители — например, дефисы между буквами. По словам исследователей, на фоне GPT-5 именно GPT-4o остаётся самой стабильной и надёжной моделью.

Интересно, что OpenAI недавно вернула GPT-4o в доступ для подписчиков ChatGPT Plus, спустя всего сутки после установки GPT-5 как основной версии. Причиной стала реакция пользователей: многие жаловались на ухудшение качества общения и отсутствие эмоциональной поддержки. Некоторые описывали удаление 4o как «утрату близкого друга».

Один из пользователей сообщил, что отменил подписку на Plus после замены моделей, возмутившись отсутствием предварительного уведомления. Он рассказал, что использовал разные версии ИИ для конкретных задач: 4o — для креатива, o3 — для логики, o3-Pro — для анализа, 4.5 — для написания текстов и так далее.

Позже OpenAI объявила, что в дальнейшем пользователи не смогут вручную выбирать модель — вместо этого система будет автоматически переключать их между ИИ в зависимости от задач.