Разработчики отмечают, что традиционный подход к генерации видео — обратная диффузия — часто приводит к снижению качества: герои в ролике могут меняться, а мелкие детали игнорируются. Кроме того, такие модели ограничены длительностью ролика — как правило, до 10 секунд.

Чтобы решить эти проблемы, SkyworkAI предложила новую архитектуру — Diffusion Forcing, которая объединяет мультимодальные языковые модели с многоступенчатой предварительной обработкой данных. Благодаря этому SkyReels V2 генерирует более согласованные видео и не ограничивается фиксированной продолжительностью.

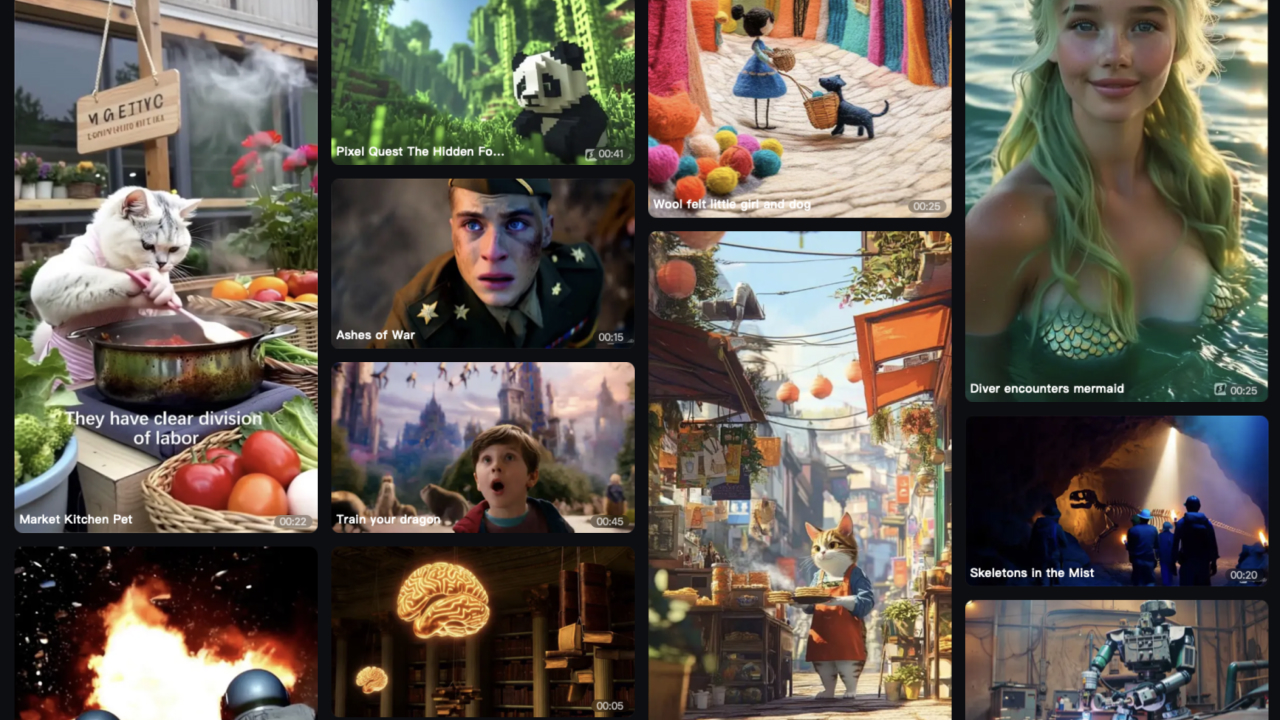

Основные режимы SkyReels V2:

В тестах VBench SkyReels V2 превзошла модели OpenSora 2.0, Wan2.1-14B, CogVideoX1.5-5B и HunyuanVideo-13B. По субъективной оценке пользователей SkyReels V2 продемонстрировала наилучшее качество генерации видео по тексту.

Исходный код модели размещён на GitHub, веса модели доступны на Hugging Face, а протестировать систему можно через платформу SkyReels.

Чтобы решить эти проблемы, SkyworkAI предложила новую архитектуру — Diffusion Forcing, которая объединяет мультимодальные языковые модели с многоступенчатой предварительной обработкой данных. Благодаря этому SkyReels V2 генерирует более согласованные видео и не ограничивается фиксированной продолжительностью.

Основные режимы SkyReels V2:

- Story Generation — автоматическая генерация видео на основе заданного сюжета.

- Image-to-Video — создание видео из изображения.

- Camera Director — управление виртуальной камерой: изменение угла обзора, зума и ракурса, а также отслеживание объектов.

- Elements-to-Video — создание визуальных эффектов и объектов для интеграции в видео.

В тестах VBench SkyReels V2 превзошла модели OpenSora 2.0, Wan2.1-14B, CogVideoX1.5-5B и HunyuanVideo-13B. По субъективной оценке пользователей SkyReels V2 продемонстрировала наилучшее качество генерации видео по тексту.

Исходный код модели размещён на GitHub, веса модели доступны на Hugging Face, а протестировать систему можно через платформу SkyReels.