Учёные Санкт-Петербургского Федерального исследовательского центра РАН представили программную систему MASAI, способную с высокой точностью определять эмоциональное состояние человека на основе видео-, аудио- и текстовой информации. По заявлению разработчиков, точность распознавания достигает 75–80%, что превосходит существующие зарубежные аналоги.

MASAI основана на комплексе нейросетевых моделей, обученных на широком спектре мультимодальных данных — от аудиовизуальных записей до текстов. При создании русскоязычной базы данных активно участвовали студенты театральных вузов, демонстрировавшие различные эмоции для обучения системы. Это позволило адаптировать модель к особенностям русской речи и мимики.

Программа распознаёт семь ключевых эмоций: радость, грусть, страх, злость, отвращение, удивление и спокойствие. Кроме того, система способна выполнять сентимент-анализ, определяя эмоциональную окраску текста — положительную, нейтральную или отрицательную.

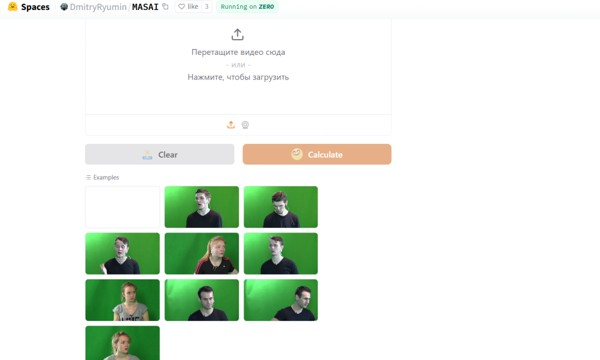

С помощью удобного интерфейса MASAI можно загружать аудио- и видеоматериалы для анализа. Также система поддерживает работу в реальном времени — она отслеживает мимику и интонации собеседника, мгновенно определяя его эмоциональное состояние.

Разработка может применяться в самых разных сферах: от цифровых ассистентов и служб поддержки до медицины и образования. Как отмечает Алексей Карпов, руководитель Лаборатории речевых и многомодальных интерфейсов СПб ФИЦ РАН, особенно полезной технология может быть в системах экстренной помощи или психологической поддержки, где важно быстро улавливать эмоциональное состояние человека.

По данным Российской академии наук, система MASAI открывает новые горизонты для развития эмоционального ИИ и создания более «чувствительных» цифровых помощников нового поколения.

MASAI основана на комплексе нейросетевых моделей, обученных на широком спектре мультимодальных данных — от аудиовизуальных записей до текстов. При создании русскоязычной базы данных активно участвовали студенты театральных вузов, демонстрировавшие различные эмоции для обучения системы. Это позволило адаптировать модель к особенностям русской речи и мимики.

Программа распознаёт семь ключевых эмоций: радость, грусть, страх, злость, отвращение, удивление и спокойствие. Кроме того, система способна выполнять сентимент-анализ, определяя эмоциональную окраску текста — положительную, нейтральную или отрицательную.

С помощью удобного интерфейса MASAI можно загружать аудио- и видеоматериалы для анализа. Также система поддерживает работу в реальном времени — она отслеживает мимику и интонации собеседника, мгновенно определяя его эмоциональное состояние.

Разработка может применяться в самых разных сферах: от цифровых ассистентов и служб поддержки до медицины и образования. Как отмечает Алексей Карпов, руководитель Лаборатории речевых и многомодальных интерфейсов СПб ФИЦ РАН, особенно полезной технология может быть в системах экстренной помощи или психологической поддержки, где важно быстро улавливать эмоциональное состояние человека.

По данным Российской академии наук, система MASAI открывает новые горизонты для развития эмоционального ИИ и создания более «чувствительных» цифровых помощников нового поколения.