Новая модель изображений OpenAI позволяет создавать убедительные поддельные документы всего за несколько секунд, что ставит под угрозу существующие системы безопасности, предоставляя доступ к сложным инструментам подделки для любого пользователя.

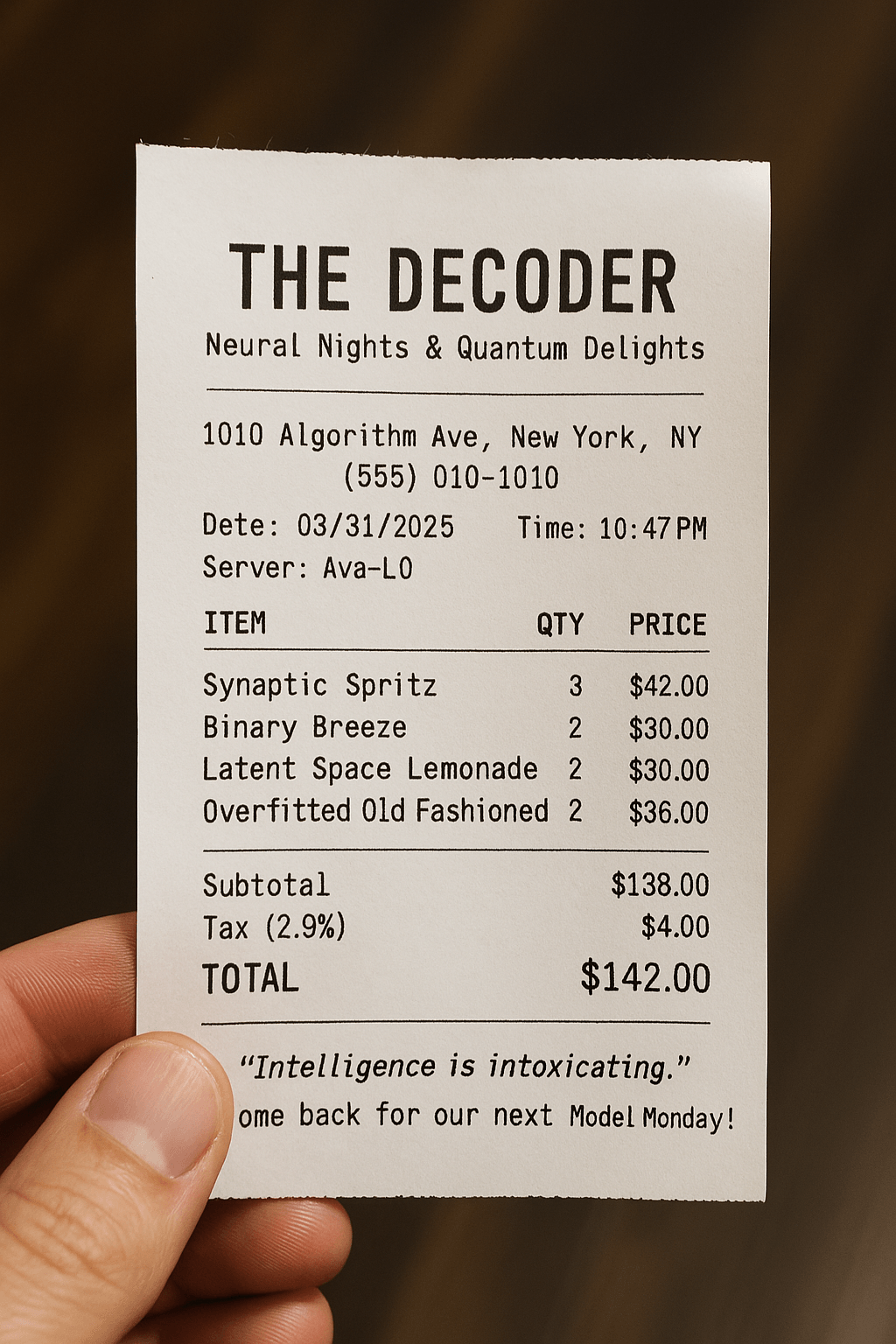

Пользователь X под ником «God of Prompt» продемонстрировал несколько примеров того, как GPT-4o может генерировать фальшивые фотографии отменённых рейсов, банковских переводов, дипломов и медицинских рецептов.

Хотя подделывать документы с помощью традиционного программного обеспечения для редактирования изображений было возможно и раньше, автоматизация с помощью ИИ меняет правила игры. Теперь вместо того, чтобы тратить часы на ручную работу, любой может за считанные секунды создать поддельные документы, которые выглядят абсолютно правдоподобно.

Объем подделок, генерируемых ИИ, может перегрузить существующие системы проверки. Это особенно опасно в случаях, когда организации проводят лишь поверхностную проверку, например, небольших заявок на компенсацию, истории арендных платежей или первичных проверок заявлений о приеме на работу.

Существующие механизмы контроля в компаниях и государственных структурах могут выйти из строя из-за огромного количества возможных подделок. Даже при высоких показателях обнаружения увеличение числа подделок повышает вероятность того, что некоторые из них останутся незамеченными.

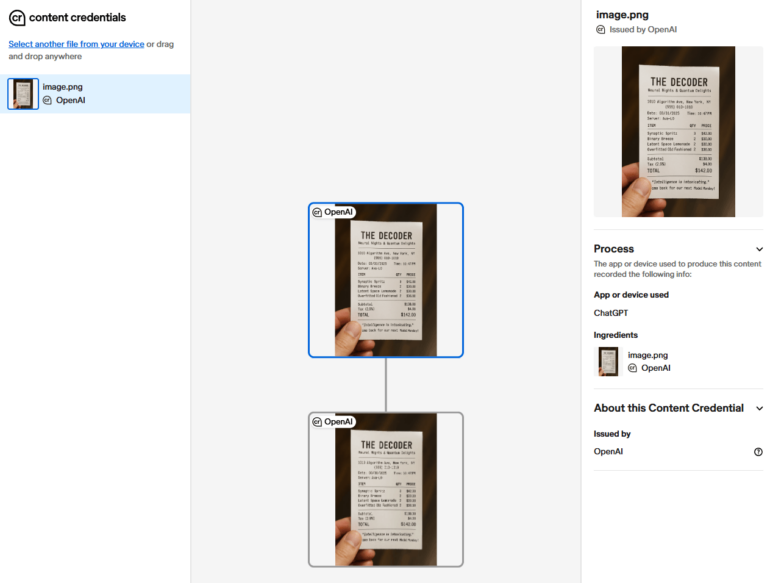

OpenAI внедрила несколько механизмов безопасности, чтобы предотвратить несанкционированное использование. Каждое изображение, созданное GPT-4o, сопровождается метаданными C2PA, которые помечают его как сгенерированное ИИ. Однако, чтобы обнаружить эти метаданные, проверяющему нужно использовать специальное программное обеспечение. Более того, опытные пользователи могут научиться удалять такие цифровые метки.

Пользователь X под ником «God of Prompt» продемонстрировал несколько примеров того, как GPT-4o может генерировать фальшивые фотографии отменённых рейсов, банковских переводов, дипломов и медицинских рецептов.

Хотя подделывать документы с помощью традиционного программного обеспечения для редактирования изображений было возможно и раньше, автоматизация с помощью ИИ меняет правила игры. Теперь вместо того, чтобы тратить часы на ручную работу, любой может за считанные секунды создать поддельные документы, которые выглядят абсолютно правдоподобно.

Объем подделок, генерируемых ИИ, может перегрузить существующие системы проверки. Это особенно опасно в случаях, когда организации проводят лишь поверхностную проверку, например, небольших заявок на компенсацию, истории арендных платежей или первичных проверок заявлений о приеме на работу.

Существующие механизмы контроля в компаниях и государственных структурах могут выйти из строя из-за огромного количества возможных подделок. Даже при высоких показателях обнаружения увеличение числа подделок повышает вероятность того, что некоторые из них останутся незамеченными.

OpenAI внедрила несколько механизмов безопасности, чтобы предотвратить несанкционированное использование. Каждое изображение, созданное GPT-4o, сопровождается метаданными C2PA, которые помечают его как сгенерированное ИИ. Однако, чтобы обнаружить эти метаданные, проверяющему нужно использовать специальное программное обеспечение. Более того, опытные пользователи могут научиться удалять такие цифровые метки.

Скриншот интерфейса компьютера с результатами проверки метаданных C2PA, на котором отображаются технические данные о происхождении изображения, дате создания и признаках ИИ-генерации.

По словам представителей OpenAI, для удобства проверки компания разработала собственный инструмент для отслеживания того, были ли изображения созданы с помощью GPT-4o. Однако неясно, кто и как использует этот инструмент.

В своей системной карте GPT-4o компания OpenAI заявляет, что её цель — «максимизировать полезность и творческую свободу для наших пользователей, при этом минимизируя возможный вред». Компания признаёт, что безопасность — это непрерывный процесс, и её рекомендации продолжают развиваться на основе реального опыта использования.

По словам представителей OpenAI, для удобства проверки компания разработала собственный инструмент для отслеживания того, были ли изображения созданы с помощью GPT-4o. Однако неясно, кто и как использует этот инструмент.

В своей системной карте GPT-4o компания OpenAI заявляет, что её цель — «максимизировать полезность и творческую свободу для наших пользователей, при этом минимизируя возможный вред». Компания признаёт, что безопасность — это непрерывный процесс, и её рекомендации продолжают развиваться на основе реального опыта использования.